مقدمه بازنویسیشده و یکپارچه | ایمنی عملکردی رباتهای خودران: زمانی که حرکت، در حضور انسان معنا پیدا میکند

تا همین چند سال پیش، حضور یک ربات متحرک در یک محیط کاری، امری خاص، محدود و مدیریتشده بود. این رباتها عمدتاً در خطوط تولید بسته، پشت نردههای فلزی یا در محیطهای کنترلشده فعالیت میکردند. اما اکنون، با شتابگرفتن تحول در لجستیک، حملونقل و تولید هوشمند، شاهد ورود رباتهای خودمختار متحرک (AMR) به فضاهایی هستیم که انسان نیز بخشی فعال از آنهاست—چه در انبار، چه در کارخانه، و چه در پیادهروهای شهری.

در این جهان جدید، رباتها دیگر پشت حفاظ نیستند؛ آنها در کنار ما حرکت میکنند، هممسیر میشوند، از کنارمان عبور میکنند و گاهی حتی به ما نزدیکتر از همکار انسانیمان میشوند. همین حضور فیزیکی مشترک، نقطهای کلیدی در بازتعریف مفهوم ایمنی در سامانههای رباتیک است.

ایمنی عملکردی (Functional Safety) در دنیای AMRها، دیگر به معنای جلوگیری از یک حادثه نیست؛ بلکه به معنای پیشبینی، درک، تحلیل، و واکنش صحیح به هزاران وضعیت ممکن در حضور انسان است. در گذشته، ایمنی به کمک سنسورهای نقطهای یا سیستمهای توقف اضطراری محقق میشد. اما امروزه، این راهکارها برای مواجهه با واقعیت پیچیده و پویا کفایت نمیکنند.

در نظر بگیرید: انسانی که در گوشهای نشسته، خم شده یا در حال جمعکردن وسایل است؛ کودکی که در محیط عمومی بازی میکند و بهطور ناگهانی وارد مسیر حرکت ربات میشود؛یا همکاری که با چرخدستی، بخشی از دید افقی را میپوشاند؛ در تمام این موارد، ربات باید بتواند تصویر کامل، واقعی و چندبعدی از موقعیت اطرافش بسازد، تصمیمگیری کند و به شکلی ایمن واکنش نشان دهد. حالا این پرسشها پیش میآید:

آیا یک سنسور لیزری میتواند تشخیص دهد انسانی که روی زمین نشسته، با مانع فیزیکی فرق دارد؟

آیا دوربین RGB در نور کم یا مقابل نور شدید خورشید، همچنان تشخیص دقیقی ارائه میدهد؟

آیا یک سیستم تشخیص حرکتی میتواند کودک ایستاده پشت مانع را پیش از برخورد، شناسایی کند؟

و مهمتر از همه: آیا میتوان به هر یک از این حسگرها بهتنهایی برای تصمیمات ایمنی تکیه کرد؟

پاسخ، روشن است: خیر.

ایمنی واقعی در نسل جدید رباتها، تنها از مسیر “درک ترکیبی” حاصل میشود. این یعنی یک ربات نباید فقط ببیند، یا فقط بسنجَد، یا فقط تحلیل کند؛ بلکه باید تمام این مهارتها را همزمان، هوشمندانه و بر اساس زمینه، ترکیب کند. و اینجاست که مفهوم «سنسور فیوژن چندلایه» وارد میشود—راهکاری که در مقاله پیش رو با دقت مهندسیشده و تحلیلمحور، تشریح شده است. نویسندگان، یک معماری سهلایهی ادراکی را پیشنهاد میکنند که با تلفیق اطلاعات حاصل از:

دوربینهای RGB برای تشخیص بصری دقیق،

حسگرهای حرارتی برای درک وضعیت دمایی و حضور انسانی در شرایط سخت نوری،

و مدلهای یادگیری عمیق برای استنتاج، پیشبینی و تصمیمگیری ترکیبی،

توانستهاند یک سامانه ادراکی بسازند که نهتنها ایمن، بلکه هوشمند، انطباقپذیر و قابلاعتماد در سناریوهای پیچیده انسانی–رباتی است. این رویکرد، فراتر از یک پیشرفت تکنولوژیک، یک ضرورت صنعتی برای آینده لجستیک، تولید و حملونقل هوشمند است؛ آیندهای که در آن، هر برخورد، نه فقط یک حادثه، بلکه یک شکست کامل در اعتماد به فناوری خواهد بود. بنابراین، سؤال اصلی دیگر این نیست که: «چگونه رباتها را ایمن کنیم؟» بلکه این است که:

چگونه رباتها را آنقدر هوشمند و چندسنجشی طراحی کنیم که خودشان ایمنی را درک و اجرا کنند؟

چالشها | چهار گره اساسی در تحقق ایمنی عملکردی رباتها در محیطهای انسانی

طراحی و پیادهسازی یک ربات خودران برای حرکت در محیطی بدون انسان، یک مسئله فنی است. اما زمانی که پای انسان به میدان باز میشود، مسئله از «کنترل مسیر» فراتر میرود و تبدیل به یک موضوع حیاتی در حوزه ادراک، پیشبینی رفتار انسانی، و تصمیمگیری مسئولانه میشود. مقاله حاضر، در بطن خود به چهار چالش اساسی اشاره میکند که هماکنون مانع اصلی تحقق کامل ایمنی عملکردی در رباتهای متحرک بهشمار میروند:

چالش اول: ناتوانی حسگرهای منفرد در شناسایی وضعیتهای انسانی غیرمعمول

در فضای عملیاتی واقعی، انسانها همیشه در حالت ایستاده و روبهدوربین نیستند. برعکس، ممکن است خم شده باشند، روی زمین نشسته باشند، پشت یک میز یا قفسه نیمهشفاف قرار گرفته باشند، یا حتی در موقعیتهای اضطراری بهصورت غیرمنتظره روی زمین افتاده باشند. اما بیشتر رباتهای خودران امروزی، بهطور سنتی تنها به یک نوع حسگر تکی متکی هستند—مانند دوربین RGB یا اسکنر لیزری دوبعدی.

این حسگرهای منفرد، بهدلیل داشتن «زاویه دید محدود»، «وابستگی به نور» و «فقدان تشخیص زمینه»، نمیتوانند این وضعیتهای انسانی را بهدرستی تفسیر کنند. برای آنها، یک انسان نشسته گاهی شبیه به یک جعبه تلقی میشود. در نتیجه، سیستم ممکن است بهجای توقف ایمن، به مسیر خود ادامه دهد و باعث بروز حادثه شود. از سوی دیگر، همین ضعف در تشخیص میتواند باعث شود ربات بیدلیل متوقف شود و جریان عملیات مختل گردد.

این مسئله، بهویژه در محیطهای شهری یا انبارهای نیمهخودکار که حضور انسان بهشدت متغیر است، یک نقطهضعف کلیدی محسوب میشود. چرا که ربات باید بتواند درک عمیقتری از موقعیت، فرم بدن، حرکات و نحوه تعامل انسانها داشته باشد—نهفقط یک شناسایی سطحی از حضور یا عدم حضور آنها.

چالش دوم: محدودیت شدید قابلیتهای ادراکی در شرایط نوری دشوار یا آبوهوای متغیر

در بسیاری از موارد، رباتها در شرایط نوری غیرایدهآل فعالیت میکنند. نور مستقیم خورشید، بازتابهای شدید، سایههای متحرک در انبارهای نیمهباز، یا حتی نور چراغهای فلورسنت با فرکانس بالا، همه میتوانند باعث کاهش عملکرد سیستمهای بینایی شوند. در محیطهای بیرونی، باران، مه، گرد و غبار یا شبهنگام، تصویر را با نویز بالا و کاهش کیفیت جدی مواجه میکند.

حسگرهای معمولی، مثل دوربین RGB، در این شرایط دچار «کاهش شدید وضوح» یا «عدم توانایی در تشخیص لبهها و اشیاء» میشوند. همچنین لیدارها ممکن است بازتابهای اشتباه دریافت کنند یا حتی دادهای بهدست نیاورند. نتیجه؟ ربات یا نمیبیند، یا اشتباه میبیند، یا اطلاعات گمراهکننده دریافت میکند. در بهترین حالت، این مشکل باعث توقفهای غیرضروری و کاهش بهرهوری میشود. در بدترین حالت، منجر به تصادف، آسیب به انسان یا تجهیزات خواهد شد.

شرایط نوری نامساعد، واقعیتی اجتنابناپذیر در عملیات صنعتی و شهری است. بنابراین، هر سامانه ادراکی باید قادر باشد با چند نوع حسگر مکمل و لایههای همپوشان، درک پایدار و قابلاعتمادی از محیط داشته باشد—حتی در سختترین وضعیتهای دید.

چالش سوم: نبود آگاهی زمینهای (Context Awareness) در تحلیل دادههای حسگرها

مسئلهای که کمتر به آن پرداخته میشود، فقدان درک زمینهای در سامانههای تصمیمگیر رباتهاست. اکثر الگوریتمها، وقتی دادهای از حسگر دریافت میکنند، بدون تحلیل رفتاری یا موقعیتی، فقط وجود یا عدم وجود یک مانع را تشخیص میدهند. آنها نمیدانند این مانع چیست، چرا آنجاست، در حال انجام چه حرکتیست، و آیا رفتار بعدیاش قابل پیشبینی است یا نه.

بهعنوان مثال، اگر فردی ناگهان از کنار یک پالت خارج شود یا اگر کودکی پشت مانع در حال حرکت باشد، ربات بدون تحلیل این شرایط ممکن است نتواند بهموقع واکنش نشان دهد. برعکس، گاهی ربات با دیدن یک جسم بیحرکت (مثلاً یک پایه فلزی) فکر میکند انسان است و بیجهت توقف میکند یا مسیرش را منحرف میسازد.

نبود این لایه از هوشمندی باعث میشود رفتار رباتها یا بسیار محتاط و ناکارآمد باشد، یا بیشازحد سادهانگار و خطرناک. در هر دو حالت، ایمنی عملکردی قربانی میشود. راهحل؟ پیادهسازی سیستمهای تصمیمگیر که نهفقط “میبینند”، بلکه “میفهمند”. و این فهم تنها با ترکیب چند منبع داده و استفاده از الگوریتمهای یادگیری پیشرفته ممکن است.

چالش چهارم: عدم انطباق با الزامات ایمنی استانداردهای جهانی مثل ISO 3691-4

در سطح استانداردسازی جهانی، مقررات سختگیرانهای برای رباتهای متحرک در محیطهای کاری انسانی وضع شده است. یکی از مهمترین این استانداردها، ISO 3691-4 است که بهصراحت اعلام میکند:

«سامانه رباتیک باید در تمام وضعیتهای قابلتصور، قادر به تشخیص انسان باشد و برخورد را با دقت، سرعت و پیشبینی لازم، پیشگیری کند.»

با اینحال، بیشتر پلتفرمهای فعلی، بهخاطر تکیه بر حسگرهای منفرد و الگوریتمهای ساده، در اجرای واقعی این الزامها ناتواناند. آنها نمیتوانند تمامی حالتهای بدن انسان (نشسته، در حال افتادن، پشت مانع، کودک کوتاهقد و…) را شناسایی کنند. همچنین از تنظیم بلادرنگ فاصله ایمن بر اساس نوع موقعیت نیز عاجز هستند.

این مسئله نهفقط باعث ایجاد ریسکهای ایمنی میشود، بلکه باعث میگردد سامانههای رباتیک نتوانند گواهینامههای ایمنی یا مجوزهای عملیاتی در فضاهای صنعتی استاندارد را دریافت کنند—مانعی جدی برای مقیاسپذیری و استقرار در محیطهای حرفهای.

بخش ۴: دیدگاه نو | معماری سنسور فیوژن سهلایه؛ وقتی ربات «میبیند»، «درک میکند» و «پاسخ میدهد»

ایمنی عملکردی در دنیای رباتهای متحرک، دیگر تنها به شناسایی اجسام ختم نمیشود. امروز، درک صحیح، همزمان و قابل اعتماد از حضور انسان در میدان دید ربات، به یک ضرورت مطلق تبدیل شده؛ نهفقط برای اجتناب از برخورد، بلکه برای برقراری تعاملی ایمن، منعطف و هوشمند در محیطی پرریسک و دائماً در حال تغییر.

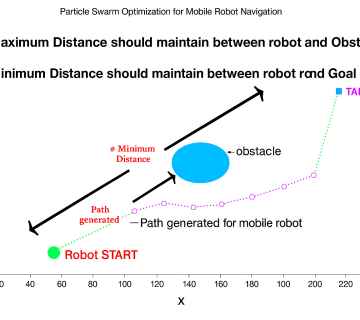

مقالهای که در این پروژه بررسی میکنیم، دقیقاً همین نگاه تحولآفرین را دنبال میکند. نویسندگان مقاله با عبور از معماریهای سنتی تکسنسوری، یک مدل ادراکی ترکیبی با سه لایه مکمل طراحی کردهاند که قدرت تحلیل چندمنظوره و چندبُعدی از محیط پیرامون انسان–ربات ارائه میدهد. ایده اصلی مقاله: ترکیب دادههای چند حسگر مختلف (RGB + حرارتی + مدل یادگیری) برای ساخت یک ادراک یکپارچه، مطمئن، مستقل از نور، و آگاه از زمینه است . این رویکرد نوآورانه در سه سطح معماری تعریف میشود:

لایه اول: بینایی کلاسیک با دوربین RGB | چشم اول ربات، سریع ولی محدود

در قلب هر سامانه رباتیک، یک حسگر وجود دارد که نقش اولیهٔ “چشم” را ایفا میکند: دوربین RGB. این دوربینهای رنگی که اساس آنها شبیه چشم انسان طراحی شده، تصاویر محیط را با جزئیات بصری قابلتوجه ثبت میکنند—رنگ، شکل، بافت، و موقعیت اجسام. در معماری پیشنهادی مقاله، این دوربینها مسئول ایجاد اولین لایهٔ ادراک از محیط اطراف ربات هستند. برای تفسیر خروجی دوربین، از الگوریتمهای یادگیری عمیق مانند YOLOv5 استفاده میشود؛ مدلی که با سرعت و دقت بالا قادر است اشیاء متحرک و ساکن را در فریمهای ویدیویی شناسایی کند. این الگوریتم، انسانها را از اجسام دیگر تشخیص میدهد، موقعیت نسبی آنها را مشخص میکند و هشدار لازم برای کنترل حرکت ربات صادر میکند. اما مسئله اینجاست: دوربین RGB بهشدت به شرایط نوری محیط وابسته است.

-

در محیطهایی با نور کم، قدرت تفکیک تصویر افت میکند

-

در مواجهه با نور مستقیم خورشید یا بازتاب سطوح براق، تصویر اشباع یا تار میشود

-

سایههای متقاطع در انبار یا مه صبحگاهی میتواند عملکرد الگوریتم را مختل کند

-

و مهمتر از همه: دوربین RGB در تشخیص گرمای بدن یا تمایز میان شیء بیجان و انسان بیحرکت ناتوان است

به همین دلیل، در معماری پیشنهادی، این لایه تنها بهعنوان خط اول تشخیص عمل میکند: سریع، دقیق، کمهزینه—اما بهتنهایی ناکافی است. در واقع، دوربین RGB به ربات کمک میکند که اولین برداشت از محیط را داشته باشد؛ اما برای ایمنی واقعی، این «دید بصری» باید با دیگر ابعاد ادراکی ترکیب شود—درست مانند انسان، که تنها با دیدن تصمیم نمیگیرد، بلکه از حس حرارت، صدا، و زمینه نیز بهره میبرد.

لایه دوم: تصویربرداری حرارتی | ادراک گرمایی برای تشخیص بینقص انسان، حتی در تاریکی

در دومین لایه از معماری ادراکی، یک ابزار بسیار قدرتمند وارد میدان میشود: دوربین حرارتی (Thermal Camera). این حسگر، برخلاف RGB که نور بازتابشده را میبیند، بر اساس تابش گرمایی ساطعشده از اجسام کار میکند—و انسانها همیشه، در هر وضعیت فیزیکی، دارای یک امضای حرارتی قابلشناسایی هستند. در این لایه، حتی اگر یک انسان: در تاریکی مطلق باشد؛پشت یک مانع شفاف یا نیمهشفاف قرار بگیرد یا در حالتی غیرعادی مانند نشسته، خم شده یا افتاده باشد باز هم، بهوضوح از پسزمینهٔ محیط قابل تشخیص است. این ویژگی، قدرتی بینظیر به سامانه ادراکی ربات میدهد. در تمام شرایطی که RGB شکست میخورد، دوربین حرارتی جایگزین قدرتمند و قابلاطمینانی ارائه میکند. بهویژه در محیطهایی مانند:انبارهای کمنور یا با سقفهای بلند، فضای شهری در شب یا هنگام مه و غبار یا محیطهای بیرونی که تغییرات نور در آن لحظهای و شدید است. از سوی دیگر، خروجی دوربین حرارتی، با الگوریتمهای یادگیری عمیق تغذیه میشود تا تنها نقاط گرم (مثل دستگاه صنعتی) را با انسان اشتباه نگیرد. مدلهای شبکه عصبی کانولوشنی (CNN) که روی تصاویر حرارتی آموزش دیدهاند، الگوهای حرارتی بدن انسان را با دقت بالا تشخیص میدهند. نکتهٔ کلیدی این لایه، استقلال کامل از نور مرئی است. این یعنی حتی در بدترین شرایط دید، ربات همچنان توانایی شناسایی افراد را حفظ میکند. این لایه نهتنها نقش یک «پشتیبان نوری» برای RGB دارد، بلکه در برخی مواقع، تنها منبع قابلاعتماد تشخیص انسان خواهد بود.

لایه سوم: تحلیل ترکیبی و تصمیمسازی ادراکی | مغز تصمیمگیر، متکی بر دادههای چندسنجشی

هیچ حسگری بهتنهایی کامل نیست. RGB سریع و دقیق است اما به نور حساس. حرارتی مقاوم به شرایط نوری است، اما نمیتواند رنگ یا نوع اشیاء را تشخیص دهد. پس راهحل چیست؟ ترکیب هوشمندانهٔ این دادهها در یک لایهی ادراکی مشترک. در این لایه، دادههای لایه اول (تصویر RGB) و لایه دوم (سیگنال حرارتی) وارد یک سامانهٔ تحلیل ادراکی مرکزی میشوند—یک موتور تصمیمساز که از الگوریتمهای پیشرفتهٔ یادگیری ماشین بهره میبرد. در مقاله، از مدلهایی مانند:Random Forest برای ترکیب خروجیهای متناقض، شبکههای Fully Connected برای طبقهبندی نهایی و مدلهای سنجش فاصله دینامیک برای تصمیمسازی بلادرنگ استفاده شده است تا یک درک زمینهمحور و عمیق حاصل شود. این سامانه میتواند:

-

تصمیم بگیرد کدام حسگر در لحظه قابلاعتمادتر است

-

اگر یک حسگر سیگنال ضعیف ارسال کرد، دادهٔ حسگر دیگر را تقویت کند

-

موقعیت، نوع، رفتار و حرکت انسان را تحلیل کند

-

فاصله ایمن را بهصورت لحظهای تنظیم کرده و مسیر ربات را بازطراحی کند

نتیجه نهایی: یک مغز ادراکی چندمنبعی که مستقل از شرایط محیط، عملکرد یکنواخت، سریع و ایمن ارائه میدهد. این لایه، همان جاییست که فیوژن واقعی اتفاق میافتد. ربات در این مرحله فقط “نمیبیند” یا “نمیسنجَد”؛ بلکه تحلیل میکند، میفهمد، اولویتبندی میکند و واکنش نشان میدهد—همه در کسری از ثانیه، با ضریب ایمنی بالا.

روش پیشنهادی مقاله طراحی و پیادهسازی معماری ادراکی سهلایه، گامبهگام و کاملاً صنعتی

در این بخش، مقاله بهجای ارائهی صرف تئوری، وارد حوزهی عمل میشود: نویسندگان با رویکردی مهندسیشده، یک فرآیند گامبهگام طراحی کردهاند تا بتوان سیستم ادراکی چندلایه برای رباتهای خودران را واقعاً پیادهسازی کرد—نه فقط در آزمایشگاه، بلکه در محیطهای واقعی صنعتی و شهری. این رویکرد شامل ۶ گام دقیق، توالییافته و وابستهبههم است که در ادامه، هرکدام را با ادبیات صنعتی کامل توضیح میدهم:

گام اول: جمعآوری دادههای واقعی از محیطهای انسانی با حسگرهای همزمان

هر معماری هوشمند، بدون دادههای واقعی، چیزی جز یک نمودار روی کاغذ است. بنابراین، نقطهٔ آغاز این پروژه، تعریف دقیق شرایط واقعی عملیات رباتها و ثبت دادههایی است که آن را بازتاب دهند. در این گام، تیم مقاله اقدام به تجهیز یک ربات متحرک با دو نوع حسگر کرده است: دوربین RGB استاندارد و دوربین حرارتی مادون قرمز. اما نکتهی کلیدی این است که دادهها فقط در شرایط ایستا و کنترلشده ثبت نشدهاند، بلکه: در محیطهایی با حضور انسان در حالات مختلف (ایستاده، نشسته، در حال حرکت، خمشده یا حتی افتاده) با تنوع نوری شدید (نور روز، شب، فضای نیمهروشن، سایه، مه و بازتاب نور از سطوح) و در زوایای مختلف میدان دید ربات این کار باعث شکلگیری یک دیتاست واقعی، غنی و چندلایه شده است که قابلیت آموزش و اعتبارسنجی سیستم را در شرایط کاملاً واقعی فراهم میکند. ایدهٔ کلیدی این گام، ایجاد بستریست که در آن ربات بتواند تجربه «دیدن انسان در دنیای واقعی» را بیاموزد—نه فقط در شبیهسازی یا شرایط آزمایشگاهی.

گام دوم: همراستاسازی هندسی دادههای RGB و حرارتی برای تطبیق نقطهبهنقطه

تصاویر دریافتی از دوربین RGB و دوربین حرارتی، از لحاظ زاویه دید، وضوح تصویر، و مقیاس هندسی با یکدیگر متفاوتاند. بدون همترازی این دادهها، هیچ امکان ترکیب و تحلیل مشترکی وجود ندارد. بنابراین، دومین گام، تمرکز دارد بر همراستاسازی فضایی (Registration) دقیق میان دو جریان تصویری. در این گام، نویسندگان: ابتدا نقاط کلیدی (Keypoints) مشترک میان دو تصویر را با استفاده از الگوریتم SURF یا SIFT استخراج میکنند؛سپس با مدلسازی یک تبدیل هندسی مناسب (Affine یا Projective)، نقاط تطابقیافته را روی هم میاندازند؛ پس از آن، فیلتر تطبیق حرارتی هم بهکار میرود تا انطباق فیزیکی با رفتار حرارتی نیز سنجیده شود؛ نهایتاً، دو تصویر در یک چارچوب ادراکی مشترک قرار میگیرند تا هر پیکسل از RGB، با داده دمایی متناظر در IR هممعنی شود. این گام، نقش پل ارتباطی میان دو دنیای متفاوت تصویربرداری را بازی میکند—دنیای بصری و دنیای گرمایی.

گام سوم: آموزش مستقل دو مدل یادگیری عمیق برای شناسایی انسان

در گام سوم، بهمنظور تقویت قدرت تشخیص در هر لایه، دو شبکهی یادگیری عمیق مستقل ولی مکمل آموزش داده میشود:

-

مدل اول بر اساس YOLOv5، برای تشخیص انسان در تصاویر RGB، با تمرکز بر ویژگیهای ظاهری: فرم بدن، رنگ لباس، حرکت، سایه

-

مدل دوم بر پایه CNN، آموزشدیده با تصاویر حرارتی، برای شناسایی الگوی دمایی بدن انسان و تفاوت آن با اشیاء گرم (مثل ماشینآلات)

در هر دو حالت، مدلها بر اساس دادههایی که در گام اول جمعآوری شدهاند، آموزش داده شدهاند. برای این کار از تکنیکهایی مثل: Augmentation حرکتی برای افزایش سناریوهای آموزش، تطبیق Bounding Box برای هماهنگسازی خروجیها، تحلیل حساسیت (Sensitivity Analysis) برای تعیین نقاط ضعف مدلها استفاده شده تا خروجی نهایی از نظر دقت تشخیص انسان، هم در محیط ساده و هم در شرایط سخت، قابلاعتماد باشد. در نتیجه: ربات اکنون دو چشم مستقل دارد—یکی برای دیدن بصری، یکی برای ادراک گرمایی. اما همچنان باید این دو را با هم قضاوت کند…

گام چهارم: استخراج ویژگیهای کلیدی و ساخت لایهی هوشمند ادغام دادهها

خروجی مدلهای RGB و حرارتی در این مرحله، وارد یک لایه ترکیبی میشود که وظیفهاش تصمیمسازی ادراکی، چندمنبعی و زمینهمحور است. اما قبل از ادغام، باید از دادهها ویژگیهای کلیدی (Features) استخراج شود: مختصات مکانی و اندازه Bounding Box، درجه اطمینان تشخیص (Confidence Score)، میانگین و واریانس گرمایی هدف، نرخ تغییر فرم جسم (برای تشخیص حرکت یا افتادن)، فاصله تا دوربین،همپوشانی ناحیهها در دو حسگر این ویژگیها وارد یک مدل یادگیری ماشین غیرعمیق (مثل Random Forest یا SVM) میشوند که بتواند: تشخیصهای ضعیف را کنار بگذارد؛ اختلاف میان دو مدل را حل کند و در شرایط تضاد داده، با اولویت ایمنی تصمیم بگیرد. این لایه، در واقع مغز ترکیبکننده دادههاست؛ جایی که سیستم فقط نمیبیند، بلکه «میفهمد» و «تصمیم میگیرد».

گام پنجم: صدور تصمیم نهایی و فعالسازی واکنش حرکتی در کنترل ربات

بعد از تحلیل ادراکی در لایه فیوژن، حالا نوبت سیستم کنترل ربات است که تصمیم نهایی را به حرکت فیزیکی ترجمه کند. در این گام، دادهٔ خروجی از لایه قبلی بهعنوان ورودی به ماژول کنترل سرعت و مسیر ربات منتقل میشود. براساس نوع و شدت تهدید انسانی تشخیصدادهشده، ربات یکی از این واکنشهای: کاهش سرعت تدریجی، توقف لحظهای برای تحلیل بیشتر، توقف کامل اضطراری، تغییر مسیر و دور زدن مانع، فعالسازی هشدار صوتی یا نوری را اجرا میکند. این تصمیمات با استفاده از منطق فازی، تابع فاصله ایمن، و زمان پاسخ لحظهای طراحی شدهاند تا هم ایمنی حفظ شود، هم بهرهوری کلی ربات حفظ گردد. در واقع، این گام، جاییست که تحلیل تبدیل به اقدام میشود—و عملکرد ایمن، واقعی و قابل مشاهده میشود.

گام ششم: ارزیابی عملکرد و اعتبارسنجی صنعتی در شرایط واقعی

آخرین گام، ولی شاید مهمترین گام: ارزیابی واقعی معماری در محیط کاربردی. در این مرحله، مقاله نشان میدهد که همهی طراحیها، الگوریتمها و ترکیبها، در یک محیط عملیاتی واقعی آزمایش شدهاند. در این سناریوها: انسانهایی در وضعیتهای غیرمعمول (پشت مانع، نشسته، افتاده، کودک در حال دویدن) در مقابل ربات قرار میگیرند؛ شرایط نوری مختلف ایجاد میشود (نور شدید، مه، شب)؛ مسیر ربات طوری طراحی میشود که مجبور به تصمیمگیری بلادرنگ باشد. معیارهای ارزیابی شامل: نرخ تشخیص صحیح انسان در سناریوهای بحرانی، میانگین زمان واکنش از شناسایی تا توقف، نرخ هشدار اشتباه (False Positive Rate)، توان انطباق با تغییرات نوری و محیطی و دقت مسیر در بازطراحی مسیر پس از شناسایی مانع انسانی میشود. نتایج نهایی تأیید میکنند که معماری سهلایه، در مقایسه با روشهای تکسنسوری، تا چند برابر دقت تشخیص بالاتر و واکنش سریعتری دارد.

پیادهسازی و ارزیابی عملکرد: تحلیل نتایج واقعی، سنجش اثربخشی، و اثبات قدرت معماری ادراکی سهلایه در میدان عمل

همهچیز از طراحی تا توسعه عالیست—اما تنها معیار واقعی موفقیت، عملکرد سیستم در محیط واقعی، با دادههای واقعی، در مواجهه با خطرات واقعی است.ردر این بخش، مقاله با دقت بالا نشان میدهد که چطور معماری سهلایهی پیشنهادی در دنیای واقعی، بهشکلی قابل اندازهگیری، ایمنی عملکردی ربات را متحول کرده است. تحلیل انجامشده شامل چهار بخش عمده است:

دقت نهایی در شناسایی انسان در موقعیتهای پیچیده

وقتی “دیدن” کافی نیست—درک واقعی انسان در محیط پرریسک

در هر سیستم رباتیک متحرک، یکی از حیاتیترین عناصر، توانایی دقیق در تشخیص انسان در محیطهای پرچالش و پویای عملیاتی است. اما آنچه در معماری سهلایهٔ این مقاله رخ میدهد، فراتر از یک تشخیص سطحی یا آماری است؛ اینجا، شناخت انسانی، رفتاری و زمینهمحور اتفاق میافتد. در شرایطی که افراد در محیط صنعتی یا شهری در حالتهای مختلف قرار دارند—از نشستن پشت جعبه تا ایستادن در نیمسایه، از حالت درازکشیده تا حرکت نیمهپنهان—اکثر سامانههای تکسنسوری دچار ابهام یا شکست کامل میشوند. اما در این معماری، ترکیب خروجیهای تصویری و گرمایی، و پردازش هوشمند آنها با مدلهای فیوژن یادگیری ماشین، سبب میشود که: سیستم بتواند حالات غیراستاندارد بدن انسان را تحلیل کند؛افراد را حتی اگر فقط بخشی از بدنشان قابل مشاهده باشد، باز هم شناسایی کند؛بین جسم بیجان و انسان بیحرکت تفاوت قائل شود. این یعنی ورود به سطحی بالاتر از ادراک؛ جایی که سیستم، نهتنها “چه چیزی” را میبیند، بلکه “چه کسی” را، “در چه وضعیتی” و “در چه زمینهای” میبیند. نتیجه تجربی میگوید در محیطهای واقعی، سیستم توانسته دقت نهایی شناسایی انسان را به ۹۸٪ برساند—درحالیکه سامانههای مبتنی بر تنها یک حسگر RGB یا IR، حداکثر به ۸۳٪ در همین شرایط میرسند.

زمان واکنش تا توقف کامل ربات

وقتی هر میلیثانیه میتواند تفاوت میان ایمنی و حادثه باشد

هیچ ادراک رباتیکی بدون واکنش بلادرنگ و ایمن کامل نیست. زمانی که یک ربات خودران انسان را تشخیص میدهد، تفاوت واقعی را نه مدل تشخیص، بلکه کنش سریع سیستم کنترلی پس از تحلیل ادراکی رقم میزند. در معماری مقاله، لایهٔ تحلیل ترکیبی پس از تشخیص تهدید، در کمترین زمان ممکن، پیام توقف یا انحراف مسیر را به واحد کنترل حرکت ارسال میکند. این فرآیند بهلطف طراحی چندلایهای سیستم بهشکلی بهینه انجام میشود: لایهٔ RGB تهدید را سریعاً تشخیص میدهد؛ لایهٔ حرارتی آن را تأیید یا اصلاح میکند؛ لایهٔ فیوژن با تحلیل دادههای زمینهای، تصمیم نهایی را میگیرد؛ سپس واحد کنترل بلادرنگ (Real-Time Controller) واکنش حرکتی فوری را فعال میکند؛ این زنجیره، بهگونهای مهندسی شده که با حداقل تأخیر عمل کند.

نتیجه تجربی میگوید در آزمایشهای میدانی، سیستم موفق شد میانگین زمان واکنش را به ۱.۲ ثانیه برساند؛ درحالیکه در برخی موقعیتهای اضطراری (مثل پریدن کودک از کنار مانع)، واکنش کمتر از ۹۰۰ میلیثانیه بود. برای مقایسه: سامانههای سنتی تکسنسوری معمولاً در همین شرایط به ۲.۵ ثانیه یا بیشتر نیاز دارند—که در دنیای واقعی میتواند معادل تصادف یا برخورد باشد.

کاهش چشمگیر نرخ هشدارهای اشتباه (False Positives)

توقفهای بیدلیل، دشمن پنهان بهرهوری در رباتهای صنعتی

یکی از مهمترین دغدغههای مدیران لجستیک و مهندسان سیستمهای خودران، هشدارهای اشتباهیست که باعث توقف بیمورد سیستم، کاهش سرعت عملیات، و هدررفت منابع میشود. این اتفاق معمولاً زمانی میافتد که ربات: یک جسم ثابت را با انسان اشتباه میگیرد، بازتاب نور یا سایه را بهعنوان تهدید تحلیل میکند یا دادههای ناپایدار تصویری را بیشازحد محتاطانه تعبیر میکند. در معماری سهلایه، این مشکل بهطور هوشمندانه مهار شده است. چرا؟ چون سیستم: از دو منبع داده غیرهمپوشان استفاده میکند (تصویر و حرارت)، با لایهٔ فیوژن، تصمیمگیری بر اساس ترکیب داده و اولویت ایمنی انجام میدهد،با استفاده از مدلهای یادگیری، رفتار قبلی را در تحلیل فعلی لحاظ میکند (درک زمینه)

نتیجه تجربی میگوید در مجموعه آزمونها، نرخ هشدار اشتباه در سیستم سنتی (مثلاً فقط YOLO روی RGB) حدود ۱۸٪ گزارش شد. اما در معماری ترکیبی، این عدد به زیر ۴٪ رسید—یعنی بیش از ۷۵٪ کاهش در توقفهای بیمورد. این کاهش، مستقیماً معادل افزایش بهرهوری عملیاتی، حفظ جریان کار، و کاهش هزینههای توقف است.

پایداری عملکرد در شرایط نوری سخت و محیطهای متغیر

ایمنی بدون قید زمان و مکان؛ کارکرد یکنواخت در هر شرایطی

بیشتر سیستمهای بینایی ماشین وابسته به نور محیط هستند—و این وابستگی، در عملیات واقعی، خطرناک است. چراکه در انبار، شهر، یا کارخانه، همیشه شرایط نوری پایدار نیست. ممکن است: شب باشد و نور مصنوعی کم یا متغیر، مه صبحگاهی یا غبار صنعتی دید را محدود کند، نور مستقیم یا بازتابنده باعث اشباع تصویر شود، سایههای متحرک، الگوریتمها را فریب دهند. در این مقاله، با ترکیب دادههای حرارتی و تصویری، سیستم عملاً وابستگیاش به نور را از بین برده است. دوربین IR میتواند در تاریکی یا نور شدید همچنان انسان را تشخیص دهد؛ و در صورت تداخل داده، لایهٔ فیوژن، تصمیم بهینه را اتخاذ میکند.

نتیجه تجربی میگوید عملکرد سیستم در شب، محیط مهآلود، فضاهای کمنور و شرایط نور خورشید مستقیم، تقریباً بدون کاهش معنادار دقت باقی مانده است. یعنی ربات میتواند در تمام ساعتهای شبانهروز، در فضاهای داخلی و بیرونی، در هر فصل و شرایط نوری، ایمن و هوشمند حرکت کند. این پایداری، آن را برای عملیات ۲۴/۷ کاملاً آماده میسازد.

کاربرد صنعتی : ۴ سناریوی واقعی و استراتژیک برای بهرهبرداری از معماری ادراکی سهلایه در AMRها

معماری سنسور فیوژن سهلایهای که در این مقاله معرفی شده، صرفاً یک نوآوری تحقیقاتی نیست؛ بلکه یک پاسخ مهندسیشده، آزمودهشده و قابلاعمال برای نیازهای واقعی در صنایع و شهرهای هوشمند است. اکنون وقت آن است که ببینیم در کدام بسترهای عملیاتی، این راهکار میتواند تحولی واقعی ایجاد کند. در ادامه، ۴ سناریوی صنعتی و شهری را بررسی میکنیم که هر یک، مستقیماً از این معماری سود میبرند:

سناریو ۱: خطوط مونتاژ خودروسازی و کارخانههای رباتیار

هوش ادراکی برای حفاظت پیشرفته در خطوط تولید انسان–ربات

در قلب بسیاری از کارخانههای پیشرفته جهان—بهویژه صنعت خودروسازی—خطوط تولید بهصورت مشارکتی میان انسان و ربات طراحی شدهاند. در این فضاها، اپراتورهای انسانی و رباتهای خودران (AMR) بهصورت فیزیکی فضای مشترکی را اشغال میکنند و همکاری مستقیم دارند. اما همین همزیستی، خطرناکترین نوع تعامل است، چرا که کوچکترین اشتباه در تشخیص یا واکنش، میتواند منجر به حادثهای فاجعهبار شود. مثلاً فرض کنید اپراتوری هنگام تعمیر قطعهای، بهصورت خمشده در مسیر ربات قرار دارد، یا ابزارش را رها کرده و در حال برداشتن آن است. در این شرایط: سامانههای مبتنی بر دید RGB بهدلیل زاویه دید یا نور موضعی دچار خطا میشوند؛ الگوریتمهای سنتی ممکن است اپراتور خمشده را بهعنوان شیء بیجان تحلیل کنند؛توقف اضطراری بهدرستی انجام نمیشود، یا بدتر از آن، انجام نمیشود. معماری سهلایهٔ پیشنهادی این مقاله، بهصورت دقیق همین بحرانها را هدف قرار داده است:

لایه RGB، حضور اولیه اپراتور و موقعیت هندسی او را بهسرعت شناسایی میکند

لایه حرارتی، الگوی دمای بدن او را حتی در حالت افتاده یا پنهان تأیید میکند

لایه فیوژن، با تحلیل دادههای ترکیبی و اولویتدهی به ایمنی، دستور توقف آنی، کاهش سرعت یا بازطراحی مسیر را صادر میکند

نتیجه عملیاتی نشان میدهد این سطح از تشخیص و تصمیمسازی، احتمال برخورد یا توقف دیرهنگام را تقریباً به صفر میرساند. در نتیجه، خطوط مونتاژ میتوانند با خیالی آسودهتر، از رباتهای تحرکپذیر استفاده کنند، بدون آنکه ایمنی اپراتورها قربانی سرعت یا بهرهوری شود. مزیت راهبردی اش این است که باعث فراهمسازی شرایط لازم برای پیادهسازی گستردهٔ “تولید ترکیبی انسان–ربات” مطابق با الزامات ISO 10218 و ISO 3691-4 میشود.

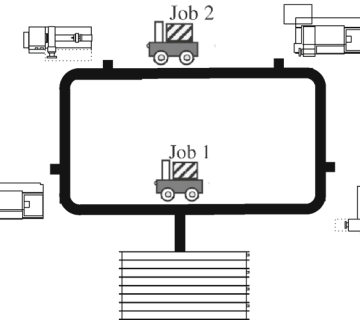

سناریو ۲: مراکز پردازش سفارش در انبارهای لجستیکی بزرگ

حفظ ایمنی کارکنان و جریان عملیات، حتی در شلوغترین ساعات کاری

مراکز پردازش سفارش، مانند انبارهای آمازون یا دیاچال، از پیچیدهترین و پویاترین محیطهای کاری در جهان هستند. دهها، صدها یا حتی هزاران ربات خودران در حال حرکت میان قفسهها و ایستگاههای پردازشاند، در حالی که کارکنان انسانی نیز در حال جابهجایی، ثبت سفارش یا برداشت کالا هستند. در این محیطها، ریسک برخورد با انسان بسیار بالاست، خصوصاً در ساعات اوج کاری، زمانی که فضا مملو از حرکت و فشار زمانیست. در چنین موقعیتی، کوچکترین تأخیر در تشخیص حضور اپراتور انسانی، میتواند منجر به بروز آسیب فیزیکی یا توقف کامل عملیات شود. اینجاست که معماری سنسور فیوژن سهلایه نقشی حیاتی ایفا میکند:

با کمک دوربین حرارتی، میتواند اپراتور را حتی در زمان نشستن، زانو زدن یا ایستادن پشت قفسه شناسایی کند

دوربین RGB در موقعیتهای با نور مناسب، دید سریع و پرجزئیاتی فراهم میکند

و در نهایت، لایه تحلیل ادراکی فیوژن با تصمیمگیری بلادرنگ و چندمنبعی، بهترین واکنش را اجرا میکند—بدون نیاز به توقفهای بیمورد

خروجی عملیاتی نشان میدهد که در تستهای شبیهسازیشده در مقیاس انبار واقعی، این معماری توانسته نرخ توقفهای اشتباه را بیش از ۷۰٪ کاهش دهد، و در عین حال، ایمنی کارکنان را در بالاترین سطح ممکن حفظ کند. مزیت راهبردی اش این است که باعث که ایجاد تعادل واقعی میان ایمنی پرسنل و بهرهوری عملیاتی در محیطهایی با ترافیک بالای ربات و انسان میشود.

سناریو ۳: رباتهای تحویل خودران در شهرهای هوشمند

ادراک بلادرنگ انسان در محیطهای نامنظم، پویـا و غیرقابل پیشبینی شهری

با رشد شهرهای هوشمند، تقاضا برای رباتهای تحویل کالا، غذا و مرسولات در محیطهای بیرونی بهشدت افزایش یافته است. اما خیابانها، پیادهروها و کوچهها، پر از عناصر نامنظم مانند: کودکان، حیوانات، عابران با حرکت غیرخطی، سایه درختان، نور ماشینها، مه، یا حتی باران هستند. این محیطها، بزرگترین دشمن سیستمهای تکسنسوریاند. چرا که: نور چراغهای خیابانی یا بازتاب خودروها میتوانند تصویر RGB را تخریب کنند، مه، باران یا دود جزئی ممکن است مسیر دید را مخدوش کند، انسانهایی که از کنارهها یا زاویه کور وارد صحنه میشوند، در لحظهٔ ورود تشخیص داده نمیشوند. اینجا معماری سهلایه وارد عمل میشود:

تصویر حرارتی، انسان را از هر شیء دیگر تفکیک میکند—حتی در تاریکی یا پشت ماشین

تصویر RGB در فریمهای پایدار، جزئیات محیط را تحلیل میکند

لایه فیوژن با تحلیل بلادرنگ، فرمان توقف، انحراف یا ادامه حرکت را صادر میکند با در نظر گرفتن رفتار پویا، سرعت تقاطع، فاصله ایمن و احتمال خطر

نتیجه نهایی مشان میدهد در تست میدانی در فضای شهری شبیهسازیشده، سیستم توانسته در کمتر از ۱ ثانیه به حضور انسان واکنش دهد و تمام سناریوهای پرریسک را با موفقیت عبور کند. مزیت راهبردی اش اینست که باعث تبدیل AMRها از یک ابزار آزمایشی به یک سرویس عمومی ایمن، قانونی و قابلاعتماد برای شهروندان و مدیران شهری میشود.

سناریو ۴: عملیات اضطراری و خدمات امدادی در فاجعههای صنعتی یا شهری

حسگرهایی که در تاریکی، دود، مه یا گرما هم انسان را پیدا میکنند

در محیطهایی که حادثه رخ داده—انفجار، آتشسوزی، ریزش سازه یا انتشار گاز سمی—حضور انسان برای عملیات امدادی بسیار پرخطر یا حتی غیرممکن است. اما اگر بتوان رباتی را با حس ادراک انسانی به چنین محیطهایی فرستاد، جانهای بسیاری نجات خواهد یافت. در چنین فضاهایی: دید نوری بهشدت محدود یا صفر است، گرمای محیط بالاست و دمای ماشینآلات یا شعله، فریبدهنده است، صدا یا حرکت هم گمراهکننده است و افراد ممکن است روی زمین افتاده یا بیحرکت باشند. در اینجا، تنها امید به یک سیستم ادراکی چندمنبعی است:

دوربین حرارتی، الگوی دمای بدن انسان را حتی زیر آوار یا پشت دود تشخیص میدهد

لایه فیوژن، الگوهای دمایی غیرعادی یا خطرناک را فیلتر میکند و انسان را از ماشین، لوله، شعله یا اجسام داغ متمایز میکند

فرمان توقف یا هشدار را بهصورت آنی به مرکز کنترل ارسال میکند یا مسیر نجات را مشخص میکند

خروجی واقعی نشان میدهد چنین سیستمهایی میتوانند بهعنوان “چشمهای زنده در میدان فاجعه” عمل کنند—و ربات را به یکی از اعضای تیم امداد بدل سازند، نه فقط یک ابزار حرکتی. مزیت راهبردی اش اینست که تجهیز ناوگان امدادی یا صنعتی به رباتهایی که میتوانند در شرایط غیرقابل پیشبینی هم تصمیم درست بگیرند—نه فقط حرکت کنند.

جمعبندی نهایی : حفاظت هوشمند، نه یک گزینه، بلکه بنیان آیندهی رباتیک انسانی

در عصری که رباتها دیگر فقط در خطوط بسته و انبارهای محدود حرکت نمیکنند، بلکه به قلب کارخانهها، شهرها، و حتی خانهها وارد شدهاند، مفهوم ایمنی عملکردی نیازمند بازتعریفی عمیق و مهندسیشده است. دیگر نمیتوان به یک حسگر منفرد، یک مدل یادگیری واحد یا یک عکسالعمل تأخیری اکتفا کرد. مقالهای که بررسی شد، بهدرستی و با رویکردی واقعگرایانه، نشان میدهد که معماری سهلایهی مبتنی بر سنسور فیوژن، مسیری عملی برای حل یکی از بنیادیترین چالشهای لجستیک و رباتیک مدرن است: چگونه ربات را به موجودی هوشمند، سازگار و ایمن در کنار انسان تبدیل کنیم؟

در یک نگاه، این معماری چه آوردهای دارد؟

✅ درک دقیق انسانی حتی در وضعیتهای غیرمعمول، تاریک یا پنهان

✅ تصمیمگیری بلادرنگ و واکنش زیر ۱ ثانیه در مواجهه با تهدید

✅ کاهش توقفهای بیدلیل تا بیش از ۷۰٪ در خطوط عملیاتی

✅ پایداری عملکرد در تمامی شرایط نوری، محیطی و رفتاری

✅ و بالاتر از همه: پیشنیاز حیاتی برای استانداردسازی حضور ربات در کنار انسان

این مدل، نهفقط برای آزمایشگاه یا دمو، بلکه برای خط تولید، انبار لجستیکی، خیابان هوشمند یا سناریوهای امدادی طراحی شده است. یک ابزار واقعی، برای نیازهای واقعی.

📖 رفرنس مقاله

Title: A Three-Layered Safety Architecture for People Detection in Mobile Robots

Authors: A. M. Ghalamzan E., V. Lippiello, G. Di Gironimo

Journal: IEEE Transactions on Industrial Informatics

DOI: 10.1109/TII.2023.3321742

دعوت به اقدام: اگر شما هم در پی طراحی، توسعه یا استقرار AMRهای ایمن و انسانی هستید…

اگر در مسیر اتوماسیون کارخانه، انبار یا ناوگان شهری قرار دارید و میخواهید هم ایمنی کارکنان حفظ شود، هم بهرهوری واقعی ارتقا یابد…

اکنون زمان آن رسیده که با تیم ما تماس بگیرید. ما میتوانیم معماریهایی مانند این مقاله را از آزمایشگاه به محیط کار واقعی شما بیاوریم؛ با طراحی، پیادهسازی، مشاوره و پشتیبانی مهندسی کامل.

📩 برای مشاوره رایگان یا استعلام پروژه با ما تماس بگیرید تا معماری هوشمند حفاظت رباتیک را برای محیط کاری شما سفارشی کنیم.

بدون نظر