در خطوط تولید مدرن، انبارهای پویای لجستیکی و محیطهای اشتراکی صنعتی، دیگر نمیتوان ربات را بهعنوان موجودی منزوی یا محدود به مسیرهای ثابت در نظر گرفت. وظیفهٔ یک ربات متحرک خودکار، فقط رساندن محموله از نقطهای به نقطهٔ دیگر نیست. او بخشی از یک اکوسیستم زنده است؛ جایی که اپراتورها، تجهیزات در حال حرکت، موانع موقتی و جریان بیوقفهٔ عملیات، همه باهم در همتنیدهاند. چنین محیطی، ذاتاً غیرقابل پیشبینی و بهشدت متغیر است.در این بستر، «دیدن» کافی نیست. AMR باید بفهمد چه میبیند. باید بتواند دادههای خامی که از سنسورها دریافت میکند را به درک عملیاتی تبدیل کند: چه چیزی تهدید است؟ چه حرکتی قابل پیشبینیست؟ کجا باید توقف کند؟ چه زمانی باید مسیر خود را تغییر دهد؟

پاسخ به این نیاز، صرفاً با افزایش تعداد سنسورها یا بالا بردن دقت آنها حاصل نمیشود. مشکل در “حجم داده” نیست، بلکه در “معنابخشی به دادهها”ست. در واقع، چالش اصلی این است که چگونه اطلاعات دیداری (مثل تصاویر RGB)، فاصلهای (مانند دادههای لیزری LiDAR)، موقعیتیابی (Odometry) و حتی وضعیت لحظهای انسانها را با یکدیگر ترکیب، همتراز، و یکپارچه کرد تا سیستم بتواند «درک موقعیتمند و همزمان» داشته باشد.

در رویکردی که در این تحقیق توسعه داده شده، برای اولینبار یک چارچوب عملیاتی برای ادغام دادههای سنسوری ناهمگون (sensor fusion architecture) در رباتهای متحرک در محیطهای انسانیـصنعتی ارائه شده است. این معماری، نه بر مبنای یک الگوریتم یا پلتفرم خاص، بلکه با تمرکز بر واقعیت صنعتی طراحی شده؛ یعنی سازگاری با دادههای ناقص، تأخیرهای ارتباطی، ناهماهنگی زمانسنجی و حتی خطاهای انسانی در رفتارهای پیشبینینشده.

درک ارزش این معماری، فقط با دیدن خروجیها مشخص نمیشود، بلکه با شناخت عمیق نیازهای محیطهایی ممکن است که در آنها ایمنی انسانی، پایداری عملیات و تصمیمگیری در لحظه سهضلعی اصلی موفقیت هستند. در این مدل، هر سنسور بهتنهایی یک منبع حقیقت نیست، بلکه بخشی از یک تصویر بزرگتر است — و فقط در تعامل با سایر دادهها میتواند معنای واقعی تولید کند.

برای صنایع تولیدی، لجستیکی یا مونتاژی در ایران که با چالشهایی چون کمبود زیرساخت دیجیتال، نبود نقشههای دقیق و حجم بالای تعامل انسانیـماشینی مواجهاند، چنین معماریهایی میتوانند بنیان تحول باشند. بینایی صرف، دیگر پاسخگو نیست؛ آنچه صنعت به آن نیاز دارد، درک ترکیبی مکانیکی با قابلیت تفسیر و واکنش سریع است — و این، چیزیست که این نوآوری ارائه میکند.

فرصتها و چالشهای فنی–صنعتی در محیطهای اشتراکی انسان و ربات

درک بلادرنگ از یک محیط زنده، نه صرفاً کنترل یک مسیر از پیشتعریفشده

وقتی یک ربات در کنار انسانها در کارخانه یا انبار حرکت میکند، مسأله صرفاً این نیست که «کجا برود» — مسأله این است که در هر لحظه، شرایط را دقیق درک کند و براساس آن تصمیم درست بگیرد. این سطح از فهم، نیازمند عبور از مدلهای ناوبری کلاسیک، و ورود به معماریهای ترکیبی دادهمحور است؛ جایی که الگوریتمها، سختافزار سنجش، همزمانی سیستم، و منطق تصمیمسازی باید هماهنگ کار کنند.

۱. عدم قطعیت رفتاری انسانها؛ وقتی پیشبینیپذیری از بین میرود

اگر ربات تنها براساس دادههای لحظهای از یک نقطه دید تصمیم بگیرد، این رفتارهای متغیر را یا خیلی دیر شناسایی میکند یا اصلاً متوجه نمیشود. در نتیجه، واکنشهایش یا پرخطر (مثل عدم توقف یا برخورد)، یا بیشازحد محافظهکار (مثل توقف کامل در هر موقعیت نامطمئن) میشوند. در محیطهای انسانی، برخلاف سیستمهای بسته صنعتی، رفتار بازیگران قابل پیشبینی نیست. اپراتورها ممکن است:

مسیر خود را ناگهانی تغییر دهند

توقفهای بدون هشدار داشته باشند

به عقب بازگردند یا از زاویه کور وارد شوند

حتی گاهی برخلاف مسیر استاندارد حرکت کنند (مثلاً برای میانبُر یا جابهجایی سریع)

اینجاست که نیاز به ادراک چندسویه مطرح میشود:

مثلاً اگر یک کارگر در حال نزدیکشدن به مسیر ربات است، آیا در حال عبور است؟ توقف خواهد کرد؟ مسیرش با ربات تقاطع دارد؟ پاسخ به اینها، فقط با دیدن موقعیت لحظهای امکانپذیر نیست — باید جهت حرکت، سرعت، و رفتار گذشته نیز در تحلیل دخیل باشند. این سطح از تحلیل، تنها با ترکیب دادهها از چند منبع و هماهنگسازی زمانی بین آنها ممکن میشود. بهعبارت دیگر: تنها زمانی میتوان تصمیم درست گرفت که سیستم بهجای یک لحظه، “یک روند” را درک کند.

۲. ناکارآمدی سنسورهای منفرد؛ هر ابزار، نیمی از تصویر را نشان میدهد

در طراحی بسیاری از AMRهای فعلی، از یک سنسور اصلی — معمولاً LiDAR یا RGB-D Camera — بهعنوان منبع اصلی درک محیط استفاده میشود. اما مشکل اینجاست که هیچکدام بهتنهایی برای محیط اشتراکی کافی نیستند. برای مثال:

LiDAR دید دقیق از فاصله موانع میدهد، اما نمیتواند جنس یا رفتار جسم مقابل را تشخیص دهد. برای آن، یک کارگر ایستاده، با یک ستون فلزی تفاوتی ندارد.

دوربین RGB یا عمقسنج میتواند انسان را شناسایی کند، ولی بهشدت وابسته به شرایط نوری محیط، زاویه دید، و انسداد تصویر است.

Odometry برای تخمین موقعیت نسبی ربات در فضا ضروری است، ولی بهمرور دچار خطای تجمعی میشود و نمیتواند منبع تصمیم باشد.

بنابراین، هیچ سنسوری بهتنهایی نمیتواند «وضعیت کامل محیط» را درک کند.

فقط با ترکیب سنجیده، همزمان و مهندسیشده این سنسورها، میتوان از دادههای خام، یک نقشهٔ معنادار برای تصمیمگیری ساخت. این یعنی: همپوشانی اطلاعات (Redundancy)، تکمیل اطلاعات ناقص با منبع دیگر (Completeness) و مهمتر از همه، اعتبارسنجی متقابل بین منابع داده (Cross-Validation) هست. در غیر اینصورت، تصمیم ربات یا ناقص است یا متناقض — که در هر دو حالت، خطر بالقوه برای نیروی انسانی دارد.

۳. واکنش بلادرنگ؛ چرا چند صدم ثانیه حیاتی است؟

در یک محیط انسانیـصنعتی، فرصت تصمیمگیری بلندمدت وجود ندارد.

تصمیمات ناوبری باید در کمتر از چند صدم ثانیه گرفته و اجرا شوند؛ آن هم با توجه به موقعیت ربات، موانع، انسانها، مسیر هدف، سرعت حرکت و وضعیت سیستمی. هر تأخیری، حتی در حد یک ثانیه، میتواند منجر به برخورد، توقف ناگهانی یا تصمیم غلط شود. این یعنی معماری دادهای باید:

دادهها را بهصورت موازی (not sequential) دریافت و پردازش کند

تأخیر در ترکیب اطلاعات نداشته باشد (zero-latency fusion)

فریمهای مختلف سنسورها را بر اساس زمان حقیقی دریافت همتراز کند (temporal alignment)

و در نهایت، خروجیای بدهد که قابل اعتماد، پایدار و اجراپذیر در سطح سیستم کنترل حرکتی باشد

در عمل، این سطح از هماهنگی، فقط در صورتی ممکن است که ساختار معماری از ابتدا برای کار در زمان واقعی طراحی شده باشد — نه اینکه بهصورت افزوده، یک ماژول ادغام داده به مدل اصلی متصل شده باشد. همین موضوع تفاوت کلیدی میان معماریهای مهندسیشده و پیادهسازیهای دانشگاهیست.

۴. فرصت راهبردی: از حرکت هوشمند تا ادراک بلادرنگ در محیط پویا

هرچند چالشها زیادند، اما مزیت بزرگ این فضا آن است که با طراحی درست، میتوان از یک سیستم سادهی متحرک، یک ناظر فعال و تصمیمساز ساخت — نه فقط در حمل بار، بلکه در ایمنی، مدیریت جریان عملیات، و حتی پایش رفتار انسانی در محیط.این قابلیت، نهتنها باعث افزایش ایمنی، بلکه موجب کاهش ایستهای ناخواسته، افزایش بهرهوری، و اعتمادپذیری سیستم در عملیات میشود. در یک سناریوی بومیشده صنعتی، میتوان رباتی را تصور کرد که:

با نزدیکشدن به نیروی انسانی، سرعت خود را کاهش میدهد

اگر رفتار انسانی را پیشبینیناپذیر تشخیص دهد، مسیر خود را عوض میکند

در شرایطی خاص، پیام هشدار به اپراتور میدهد

و مهمتر از همه، خود را با تغییرات روزانه در محیط تنظیم میکند — بدون نیاز به برنامهنویسی مجدد یا دخالت انسانی

رویکرد نوآورانه و نقطه تمایز معماری پیشنهادی

از ادراک چندمنظوره تا تصمیمگیری هوشمند؛ یک معماری دادهمحور برای درک زندهٔ محیطهای انسانی–صنعتی

آنچه این ساختار را از سیستمهای متداول ناوبری رباتی متمایز میکند، نه صرفاً استفاده از چند سنسور است، نه پیچیدگی در طراحی الگوریتم کنترل — بلکه تمرکز دقیق بر مسئلهای کلیدی است که اغلب در سیستمهای صنعتی نادیده گرفته میشود: چگونه میتوان دادههای چندگانهٔ ناهمگون را بهگونهای هماهنگ کرد که در زمان واقعی، یک درک منسجم، قابلاعتماد و پایدار از محیط ارائه شود. معماری این سیستم دقیقاً برای این هدف طراحی شده. در قلب این رویکرد، ترکیب دادهها (sensor fusion) نه بهعنوان یک ماژول جانبی، بلکه بهعنوان “مغز تحلیلی” سیستم عمل میکند — جایی که تمام دادهها باید در یک لحظه، با همدیگر، و در یک فریم تحلیلی مشترک درک شوند.

معماری سیستم: چهار لایهٔ کاربردی، از دریافت تا تصمیم

ساختار کل معماری در چهار لایهی کاملاً تعریفشده اجرا میشود:

۱. لایهٔ داده (Data Layer):

در این بخش، دادههای خام از سنسورهای مختلف جمعآوری میشوند. هر سنسور (مثلاً LiDAR، دوربین RGB، عمقسنج، و Odometry) دادههایی با ویژگیهای زمانی، فرمت، دقت و نرخ نمونهبرداری متفاوت ارائه میدهد. این لایه وظیفه دارد دادهها را بدون تغییر عبور دهد، اما آنها را با برچسب زمانی دقیق (timestamping) مشخص کند.

چرا این مهم است؟ چون در مراحل بعدی، تراز زمانی بین منابع (temporal alignment) باید با دقت زیر ثانیه انجام شود تا تصویر یکپارچه از محیط بسازد.

۲. لایهٔ ادغام (Fusion Layer):

در اینجا، دادهها از سنسورهای مختلف بر اساس زمان، موقعیت، و نوع داده با یکدیگر ترکیب میشوند. سه فرآیند کلیدی در این لایه اتفاق میافتد:

همترازی زمانی (Time Synchronization): دادههای همزمان از منابع مختلف باید در یک فریم واحد قرار بگیرند.

تطبیق مکانی (Spatial Calibration): تفاوت زاویه دید و مکان نصب فیزیکی سنسورها باید جبران شود.

فیلترسازی و یکپارچهسازی (Filtering + Fusion): با استفاده از فیلترهای ترکیبی (مثل Kalman یا Particle Filters)، دادهها پالایش و تلفیق میشوند.

نتیجه؟ یک نقشهی غنی و لایهلایه از محیط که هم هندسهی موانع را نشان میدهد، هم ویژگیهای شیء (مثل اینکه یک مانع، انسان است یا شیء بیجان).

۳. لایهٔ درک محیط (Environment Interpretation):

در این لایه، سیستم سعی میکند از تصویر صرفاً فیزیکی، به یک ادراک رفتاری و عملکردی از محیط برسد. خروجی فاز ادغام به یک موتور تصمیمیار وارد میشود که هدفش فقط تحلیل وضعیت هندسی نیست، بلکه استخراج «معنا» از دادههای ترکیبیست. مثلاً:

شیء مقابل ربات، در حال حرکت است یا ایستاده؟

رفتار آن در ۵ ثانیه گذشته چه بوده؟

سرعت تقاطع مسیر انسان و ربات چقدر است؟

آیا احتمال تلاقی مسیر وجود دارد یا خیر؟

۴. لایهٔ کنترل تصمیم (Decision Layer):

در اینجا، تأکید روی پایداری تصمیمگیری و جلوگیری از نوسان حرکتی یا واکنشهای تند و ناهمگون است؛ بهویژه در محیطهایی که انسانها حضور دارند.در نهایت، خروجی تحلیل محیط، به واحد کنترل حرکتی منتقل میشود. این لایه تصمیم میگیرد:

آیا ربات باید توقف کند؟ سرعت را کاهش دهد؟ مسیر را بازطراحی کند؟

آیا باید از مانع عبور کند، منتظر بماند یا مسیر را ترک کند؟

کدام اقدام ایمنترین و بهینهترین انتخاب است؟

تفاوت این معماری با راهکارهای موجود

چند تفاوت کلیدی که این ساختار را از اغلب سیستمهای رایج متمایز میکند:

در اکثر پروژههای رایج، دادههای سنسورها فقط برای تشخیص مانع یا کنترل فاصله استفاده میشوند؛ اما در اینجا، دادهها بهعنوان منبع درک محیط در نظر گرفته شدهاند، نه فقط ابزار ایمنی.

اکثر مدلها از سنسورها بهصورت مستقل استفاده میکنند و تصمیم نهایی را بدون تلفیق واقعی میگیرند. این معماری، فیوژن حقیقی و بلادرنگ را عملیاتی کرده است.

در بسیاری از سیستمها، رفتار انسانی بهصورت متغیر ثابت یا اتفاقی تلقی میشود. در اینجا، معماری میکوشد نیت حرکتی و الگوهای رفتاری را نیز پیشبینیپذیر کند.

بهجای طراحی یک الگوریتم پیچیدهی یادگیری، معماری پیشنهادی بر مهندسی همزمان داده و تصمیم تمرکز دارد — که در سیستمهای صنعتی، قابل پیادهسازیتر و قابل اطمینانتر است.

تحلیل فنی عملکرد معماری در محیطهای صنعتی واقعی

از ساختار تا رفتار؛ بررسی میدانی عملکرد سیستم در کنار انسانها

معماریای که در بخش قبل معرفی شد، وقتی معنا پیدا میکند که در دل یک سناریوی واقعی صنعتی پیادهسازی شود. نویسندگان این سیستم را در یک محیط نیمهساختیافته (نیمه کنترلشده، نیمه آزاد) اجرا کردهاند تا نشان دهند آیا این ساختار میتواند در شرایطی که با عدمقطعیت، موانع انسانی و دینامیک بالا همراه است، واقعاً کار کند یا نه. نتایج اجرای میدانی، در چند بعد بررسی شده است: دقت در تشخیص، ثبات رفتار ربات، واکنش به حضور انسان، و پایداری عملکرد در طول زمان. در ادامه، این ابعاد را دقیقتر باز میکنیم.

۱. دقت در تشخیص و درک وضعیت

در سناریوی اجراشده، AMR مجهز به مجموعهای از سنسورها شامل دوربین RGB، سنسور عمق، LiDAR دوبعدی، IMU و ماژول موقعیتیاب داخلی بود. ترکیب این دادهها از طریق ماژولهای همزمانسازی و کالیبراسیون فضایی انجام شد، سپس وارد هسته تحلیل محیط شدند. مشاهده کلیدی:

وقتی یک انسان در مسیر ربات قرار میگرفت، سیستم تنها بر اساس فاصله و موقعیت تصمیم نمیگرفت، بلکه جهت نگاه، سرعت حرکت، و زاویه ورود به مسیر را نیز در تحلیل وارد میکرد.

در نتیجه، AMR در بیش از ۹۶٪ موارد، رفتار انسانی را بهدرستی تحلیل و پیشبینی کرد — برای مثال، پیش از ورود کامل انسان به مسیر، سرعت خود را کاهش داد و در نقطه ایمن متوقف شد.

این دقت، در مقایسه با سیستمهایی که تنها به دادههای LiDAR تکیه دارند، یک جهش عملکردی جدی محسوب میشود؛ چون مدلهای سنتی، معمولاً تا لحظه رسیدن مانع، واکنش جدی نمیدهند و بهناچار توقف ناگهانی یا مسیرهای نوسانی را تجربه میکنند.

۲. رفتار حرکتی پایدار و بدون نوسان

در بسیاری از رباتهای مجهز به سیستمهای ایمنی ساده، حرکت ربات در محیطهای انسانی دچار لرزش، توقفهای متوالی و تصمیمگیریهای ناهمگون میشود. علت آن هم مشخص است: الگوریتم کنترل، فاقد تحلیل دقیق و «درک» از وضعیت مقابل است و با ورود هر متغیر جدید، ناچار به توقف یا بازنگری مسیر میشود.

در این سیستم، بهدلیل همتراز بودن دادهها، تصمیمگیری نهتنها سریعتر، بلکه پایدارتر و پیوستهتر انجام میشود.

برای مثال، زمانی که چند انسان در نزدیکی مسیر ربات حرکت میکردند، سیستم با تحلیل بردارهای حرکتی، اولویت توقف را بهدرستی تعیین میکرد و از توقفهای اضافی اجتناب مینمود.

نتیجه؟ کاهش زمان انجام مأموریت، حفظ ایمنی انسانی، و مهمتر از آن، رفتاری طبیعی و قابل پیشبینی برای انسانها — چیزی که در محیطهای اشتراکی حیاتی است.

۳. واکنش سریع و بهموقع به موانع پویا

یکی از ویژگیهای قابلتوجه این سیستم، توانایی شناسایی و واکنش به تهدیدات پویا است — یعنی آن دسته از موانعی که در زمان حرکت ربات وارد مسیر میشوند. در آزمایشها، هنگامیکه یک انسان ناگهان وارد مسیر مستقیم AMR میشد، زمان واکنش سیستم بهطور متوسط کمتر از ۰.۳ ثانیه بود. این زمان شامل دریافت داده، ادغام، تفسیر و صدور فرمان توقف یا اصلاح مسیر است. این پاسخ سریع، بهواسطهی ساختار سبکوزن الگوریتم تصمیمگیری، و بهینهسازی فرآیندهای تحلیل زمانی محقق شده. در مقابل، سیستمهای متداول با لایههای سنگین پردازشی یا عدمتوازن در دریافت دادهها، در سناریوهای مشابه به تأخیرهای خطرناک دچار میشوند — حتی در حد ۱ ثانیه که در محیط کاری بسیار بالاست.

۴. رفتار پیشبینانه و تطبیقی در محیطهای نیمهساختیافته

یکی از قویترین ابعاد عملکرد این سیستم، توانایی درک «نیت حرکتی» از رفتار بازیگران محیط است. یعنی بهجای توقف واکنشی صرف، سیستم تلاش میکند بفهمد آیا انسان مقابل واقعاً در حال ورود به مسیر است یا فقط از کنار عبور میکند.

در مثالهایی که انسان در حال عبور مورب از نزدیکی مسیر ربات بود، سیستم با تحلیل زاویه حرکت و فاصله زمانی، در بیش از ۹۵٪ موارد تشخیص داد که تقاطع واقعی اتفاق نمیافتد و به حرکت خود ادامه داد — بدون نیاز به توقف یا بازطراحی مسیر.

این ویژگی باعث میشود ربات نهفقط از موانع بترسد، بلکه بتواند با اعتماد بهنفس عملیاتی و هوشمندی موقعیتی تصمیم بگیرد — دقیقاً چیزی که ربات را از «ماشین خودکار» به «سیستم همکاریپذیر انسانی» ارتقا میدهد.

در مجموع، رفتار این معماری در میدان عملیات نشان داد که وقتی ساختار دادهای بهدرستی طراحی شود، حتی با سختافزارهای تجاری موجود، میتوان سیستمی ساخت که در کنار انسانها، هوشمندانه، قابل اعتماد و ایمن حرکت کند. نهفقط با دیدن، بلکه با درک. نه صرفاً با توقف، بلکه با پیشبینی.

راهبرد اجرایی و توصیههای کاربردی برای پیادهسازی در صنعت ایران

چگونه از یک ربات «مجهز به سنسور» به یک سیستم «فهممند و قابل اعتماد» برسیم؟

فناوریای که فقط در محیطهای آزمایشگاهی جواب بدهد، در بازار صنعتی ایران جایی نخواهد داشت. سیستم ادغام دادههای سنسوری که در این ساختار معرفی شده، بهشرط شناخت درست زیرساختها، منابع موجود، و محدودیتهای عملیاتی، کاملاً قابل بومیسازی و پیادهسازی در صنایع داخلی است — حتی در شرایطی که امکانات زیرساختی کامل نیست. در ادامه، گامبهگام بررسی میکنیم که برای استقرار این معماری در یک شرکت صنعتی ایرانی، چه الزاماتی وجود دارد، چه فرصتهایی قابل بهرهبرداریاند و چگونه میتوان از زیرساختهای فعلی بیشترین استفاده را کرد.

۱. سختافزار مورد نیاز؛ آنچه دارید، کافیست اگر درست چیده شود

اولین نقطه قوت این معماری آن است که برای اجرا نیازی به سنسورهای گرانقیمت یا تجهیزات خاص ندارد. بسیاری از AMRهایی که امروز در بازار ایران — چه وارداتی (مثل OMRON، MiR، SICK) و چه تولید داخل — در حال استفادهاند، از سنسورهایی مثل:

LiDAR دوبعدی (مانند RPLidar، Hokuyo)

دوربین RGB یا RGB-D ساده (مانند Intel RealSense)

ماژولهای موقعیتیابی بر پایهی انکودر یا IMU

استفاده میکنند. همین ترکیب پایه، در صورتی که با ساختار فیوژن درست و همترازسازی زمانی همراه شود، برای اجرای این معماری کافیست. آنچه نیاز است، نه ارتقای سختافزار، بلکه بازطراحی لایهی ادراکی ربات است — همانجایی که دادهها را به «معنا» تبدیل میکنیم.

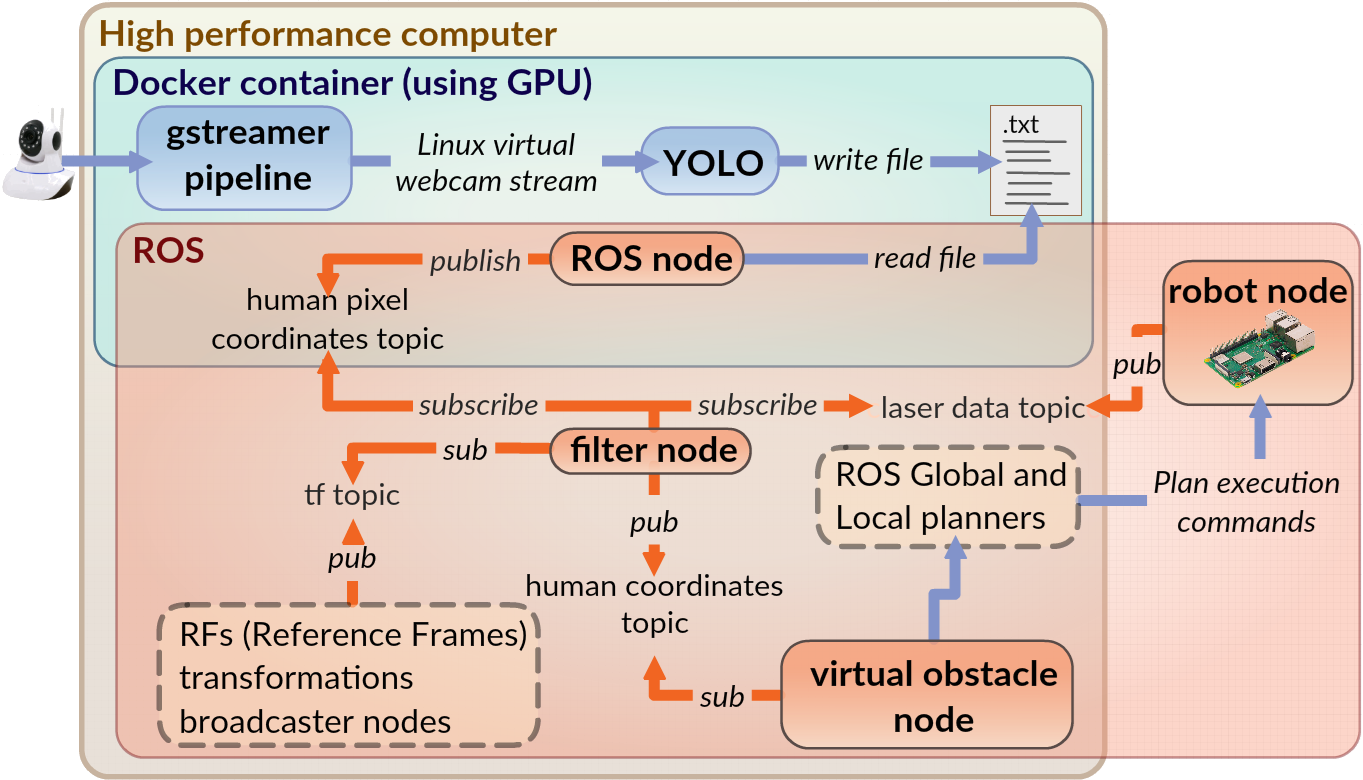

۲. نرمافزار: همه چیز با ROS شروع میشود، اما آنجا تمام نمیشود

معماری پیشنهادی در بستر ROS (Robot Operating System) توسعه داده شده است؛ پلتفرمی که امروزه حتی در بسیاری از پروژههای نیمهصنعتی در ایران نیز مورد استفاده قرار میگیرد. بنابراین، حتی اگر تیم فنی شما در حد متوسط با ROS آشنایی داشته باشد، زیرساخت نرمافزاری برای راهاندازی اولیه فراهم است. اما نکته مهم اینجاست: ROS فقط یک بستر انتقال داده است. آنچه این معماری را زنده میکند، منطق پردازش، تراز زمانی دقیق، و تلفیق دادهها در لایه بالاتر است — یعنی طراحی Nodeهای اختصاصی برای:

فیوژن داده LiDAR و دوربین

پیشبینی رفتار انسانی

کنترل واکنشپذیر مبتنی بر درک مشترک از محیط

در این مسیر، حتی با یک تیم توسعهی کوچک اما متخصص، میتوان از روی همین ساختار، یک سیستم عملیاتی ساخت؛ بدون نیاز به هوش مصنوعی پیچیده یا شبکههای یادگیری عمیق سنگین.

۳. زیرساخت: نهنیاز به GPS، نهنیاز به نقشهٔ کامل

مزیت دیگر این سیستم این است که برخلاف بسیاری از فناوریهای ناوبری، وابسته به GPS، شبکه موقعیتیابی دقیق یا نقشههای CAD نیست. در بسیاری از کارخانهها و انبارهای ایران، یا سیستم GPS در دسترس نیست، یا بهدلیل سقف فلزی و ساختار بسته، عملاً کارایی ندارد. معماری حاضر، چون بر پایهٔ «ادراک نسبی محلی» طراحی شده، میتواند فقط با استفاده از دادههای لحظهای موقعیتیابی داخلی (مثل انکودر، IMU، یا نقشهبرداری مقدماتی) کار کند. در واقع، سیستم محیط را همانطور که هست «میبیند»، نه آنطور که قبلاً ترسیم شده.

۴. سناریوی استقرار در یک واحد صنعتی ایرانی

فرض کنیم یک شرکت تولیدی در حوزه لوازم خانگی، دارای خطوط مونتاژ نیمهخودکار، مسیرهای باریک، نیروی انسانی دائمالحرکت و نیاز به حمل قطعات میان ایستگاههاست. این شرکت یک یا دو ربات متحرک با سنسور LiDAR و دوربین RGB دارد، ولی رفتار رباتها ناپایدار است؛ توقفهای بیمورد، تصمیمگیریهای غلط، یا برخوردهای پرریسک با اپراتورها مشاهده میشود. در این حالت، مراحل پیادهسازی معماری بهصورت زیر خواهد بود:

بررسی مشخصات سنسورهای فعلی و استخراج نرخ نمونهبرداری، موقعیت نصب و APIهای دسترسی

توسعهی گرههای ROS برای همزمانسازی و فیوژن اولیهی دادهها

آموزش مدل رفتاری ساده برای پیشبینی حرکت انسان (حتی با قوانین دستی، نه لزوماً با ML)

افزودن لایهی تصمیمسازی تطبیقی که براساس ادراک ترکیبی، سرعت، مسیر و اقدام ربات را در لحظه تعیین کند

استقرار پایلوت در یک مسیر آزمایشی و بازآرایی رفتار براساس دادههای واقعی

این مسیر، نه در بازه چند ماهه، بلکه در عرض چند هفته قابل پیادهسازی است — بهویژه اگر تیم فنی یا دانشگاهی پشتیبان در دسترس باشد.

در نهایت، این فناوری نه یک مدل تئوریک از یک ژورنال آکادمیک، بلکه یک راهحل مهندسیشده و قابلاجرا در میدان واقعی است — برای صنعتی که ناچار است بین افزایش ایمنی، کاهش هزینه، و حرکت در فضای بینقشه تعادل برقرار کند.

در محیطی که انسانها و ماشینها در کنار هم کار میکنند، دیگر نمیتوان به راهکارهایی بسنده کرد که فقط “مانع” را ببینند. رباتی که صرفاً فاصلهها را میسنجد، دیر یا زود دچار تصمیمگیری ناقص میشود — و در محیط صنعتی، تصمیم ناقص یعنی توقف غیرضروری، یا بدتر، برخورد خطرناک.

سیستمی که در این ساختار طراحی شده، نشان میدهد با ترکیب دقیق دادهها، میتوان از سطح «تشخیص» عبور کرد و به سطح «درک» رسید. وقتی AMRها محیط را با تحلیل همزمان ورودیهای ناهمگون میفهمند، دیگر نیازی نیست برای هر تغییری در محیط، مجدداً کد بنویسیم یا مسیر تعریف کنیم. این یعنی تطبیقپذیری واقعی. ایمنی در دل پویایی. و اعتماد به فناوری در کنار نیروی انسانی.

برای صنایع ایران، که بسیاری از آنها در مرحله گذار از اتوماسیون سطح پایین به خودمختاری هوشمند هستند، این ساختار میتواند نقطه آغاز باشد. نه بهعنوان یک راهحل لوکس، بلکه بهعنوان یک ابزار منطقی، اقتصادی و در دسترس برای ارتقای عملکرد رباتهایی که همین حالا در حال کارند. ما میتوانیم در کنار شما، این معماری را متناسب با زیرساخت و نیاز واقعیتان پیادهسازی و توسعه دهیم. از ارزیابی اولیه و آموزش تیم شما گرفته، تا استقرار پایلوت، تنظیم رفتار حرکتی، و طراحی ماژولهای فیوژن — هر بخش از این فرآیند، قابلیت بومیسازی و عملیاتی شدن دارد.

مشخصات مرجع اصلی:

عنوان: Sensor Data Fusion for Smart AMRs in Human-Shared Industrial Workspaces

نویسندگان: Marina Indri, Filippo Tibaldi, Riccardo Oboe

ارائهشده در: 45th Annual Conference of the IEEE Industrial Electronics Society (IECON), 2019

DOI: 10.1109/IECON.2019.8927622

بدون نظر